Kunstmatige intelligentie (AI) heeft zich in razendsnel tempo ontwikkeld en is niet meer weg te denken uit onze moderne samenleving. Steeds vaker implementeren organisaties AI-systemen binnen hun manier van werken. Deze groei brengt echter risico’s met zich mee. Want hoe zorg je ervoor dat AI-systemen veilig, transparant en verantwoord worden toegepast?

De Europese AI Act en de internationale ISO 42001 bieden hierop een antwoord. Deze eerste AI-wetgeving en normering scheppen duidelijke kaders voor het verantwoord gebruik van kunstmatige intelligentie binnen organisaties. In dit blog gaan wij dieper in op wat de wet en norm inhouden, voor wie ze gelden en hoe jouw organisatie zich hierop kan voorbereiden.

In dit blog:

- Wat is de EU AI Act?

- De internationale norm voor AI: ISO 42001

- Waarom is de Europese AI Act nodig?

- Voor wie gelden de AI Act en ISO 42001?

- Wanneer gaat de AI Act in werking?

- Wat zijn de vereisten van de Europese AI Act?

- Wat zijn de gevolgen van niet-naleving?

- Hoe kun jij je als organisatie voorbereiden op de EU AI Act?

- Hoe voldoe je als organisatie aan de ISO 42001?

Wat is de EU AI Act?

De Europese AI Act (ook aangeduid als EU AI Act, AI-wetgeving of AI-verordening) is een wet die in 2024 aangenomen is door de Europese Unie. De wet reguleert het ontwerp, de ontwikkeling en het gebruik van AI-systemen. Doel van de AI Act is te waarborgen dat AI-systemen die in de EU worden ontwikkeld of toegepast veilig, betrouwbaar en transparant functioneren.

Voor organisaties die AI ontwikkelen en aanbieden wordt dankzij de AI Act duidelijk aan welke eisen systemen in Europa moeten voldoen. Organisaties die AI inzetten kunnen dankzij de wetgeving erop vertrouwen dat AI-systemen van hoge kwaliteit en betrouwbaar zijn. Daarnaast worden mensen die in aanraking komen met AI beter beschermd dankzij de eisen en rechten uit de EU AI Act.

De risicogebaseerde aanpak van de AI Act

De wet maakt gebruik van een risicogebaseerde aanpak en vier categorieën voor AI-toepassingen:

- Verboden toepassingen:Dit zijn AI-systemen die beschouwd worden als een bedreiging voor de veiligheid, het levensonderhoud en de rechten van de mens. Denk aan AI-systemen voor schadelijke manipulatie, emotieherkenning in het onderwijs en onterechte social scoring.

- Hoog-risico toepassingen: Hierbij kun je denken aan AI in medische apparatuur, HR-processen of financiële diensten waarbij de bescherming van gegevens van groot belang is.

- Beperkt risico toepassingen: Bijvoorbeeld chatbots waarvoor transparantie richting gebruikers een verplichting is. Hierbij moeten mensen erop gewezen worden dat zij interactie hebben met een machine.

- Laag-risico toepassingen:Dit zijn toepassingen zoals spamfilters. Hiervoor gelden nagenoeg geen verplichtingen omdat de risico’s minimaal zijn. Wel kunnen ontwikkelaars vrijwillig gedragscodes opstellen en naleven.

De internationale norm voor AI: ISO 42001

In tegenstelling tot de AI Act die alleen voor Europa geldt, is de ISO 42001 een internationale norm voor AI. De norm helpt organisaties om hun processen zo in te richten zodat zij aantoonbaar kunnen voldoen aan de AI Act. Met het behalen van de certificering toon je aan dat je AI verantwoord, transparant en betrouwbaar toepast.

Waarom is de Europese AI Act nodig?

De snelle ontwikkelingen op het gebied van AI brengen naast voordelen ook risico’s met zich mee. Zo is het lastig te achterhalen waarom een AI-systeem een bepaalde beslissing of voorspelling heeft gedaan of een bepaalde actie heeft ondernomen. Dit maakt het moeilijk te beoordelen of iemand oneerlijk benadeeld is. Er is dus een gebrek aan transparantie. Daarnaast is er een risico omtrent veiligheid en misbruik van persoonsgegevens. De Europese AI Act is ontworpen om deze risico’s te beperken en tegelijkertijd innovatie binnen de EU te bevorderen.

De ISO 42001 helpt je te voldoen aan de eisen van de EU AI Act. Maar dat niet alleen. Een certificering verhoogt ook het vertrouwen bij gebruikers, klanten en toezichthouders. Organisaties die zich vroegtijdig voorbereiden, positioneren zich als een betrouwbare en verantwoordelijke partner binnen hun branche.

Voor wie gelden de AI Act en ISO 42001?

De AI Act en ISO 42001 gelden voor de volgende organisaties:

- Ontwikkelaars en producenten: die AI-systemen ontwerpen en bouwen. Hierbij gelden er extra eisen voor makers van grote taalmodellen.

- Importeurs en distributeurs:die AI-systemen van buiten de EU aanbieden of importeren

- Organisaties die AI-systemen inzetten voor professionele doeleinden: Inclusief overheden en zorginstellingen.

- Fabrikanten:die AI-systemen integreren in hun eigen producten of software.

Wanneer gaat de AI Act in werking?

De Europese AI Act is op 1 augustus 2024 in werking getreden en gaat gefaseerd van kracht:

- In februari 2025 zijn bepalingen over verboden praktijken van kracht gegaan. Daarnaast moeten organisaties die AI inzetten, vanaf februari 2025 werken aan AI-geletterdheid bij werknemers en andere personen die namens de organisatie AI-systemen gebruiken.

- Vanaf augustus 2025 zijn bepalingen voor AI modellen voor algemeen gebruik van kracht gegaan. Dit zijn modellen die ontworpen zijn om een breed scala aan taken uit te voeren (zoals ChatGPT). Vanaf augustus 2025 moet het toezicht hierop ook ingericht zijn.

- In augustus 2026 start het toezicht op de verplichtingen voor AI met een hoog risico en op de transparantieverplichtingen voor bepaalde AI-systemen. Daarnaast treedt de Nederlandse ‘regulatory sandbox’ in werking. Binnen deze sandbox bieden toezichthouders ondersteuning aan aanbieders van AI-systemen die tijdens de ontwikkeling vragen hebben over het voldoen aan de AI Act.

- Vanaf augustus 2027 start het toezicht op AI met een hoog risico in bestaande gereguleerde producten en is de AI Act volledig van kracht.

- Uiterlijk zes jaar na de inwerkingtreding, in 2030, moeten alle AI-systemen bij overheidsorganisaties die voor de inwerkingtreding op de markt zijn gebracht voldoen aan de eisen voor hoge risico AI-systemen.

Wat zijn de vereisten van de Europese AI Act?

De precieze verplichtingen zijn afhankelijk van de risicocategorie van het AI-systeem. Voor AI-toepassingen met een hoog risico gelden onder meer de volgende vereisten:

- Uitvoeren van risicoanalyse

- Waarborgen van transparantie over de werking van AI-systemen

- Vastleggen van documentatie en het bijhouden van logbestanden

- Organiseren van menselijk toezicht op AI-processen

- Integreren van veiligheids- en kwaliteitsmanagement in de bedrijfsvoering

Bedrijven moeten kunnen aantonen dat hun AI-systemen voldoen aan deze verplichtingen, inclusief passende procedures en controles.

Wat zijn de gevolgen van niet-naleving?

Het niet naleven van de Europese AI Act kan leiden tot aanzienlijke sancties. Boetes kunnen oplopen tot 35 miljoen euro of 7% van de jaaromzet, afhankelijk van de ernst van de overtreding. Naast de financiële risico’s betekent dit ook een aantasting van reputatie en vertrouwen.Het is daarom van belang om als organisatie tijdig maatregelen te treffen om aan de wetgeving te voldoen. Bijvoorbeeld door nu al het ISO 42001 certificaat te behalen.

Toezicht op de AI Act

De naleving van de eisen aan AI-systemen met een hoog risico en de eliminatie van verboden AI worden gecontroleerd door nationale toezichthouders. De naleving van de verplichtingen voor grote AI-systemen wordt op Europees niveau gecontroleerd door het Europees AI bureau.

Hoe kun jij je als organisatie voorbereiden op de EU AI Act?

Een goede voorbereiding start met inzicht in het huidige gebruik van AI binnen de organisatie. Welke toepassingen zijn er, hoe risicovol zijn deze en welke beheersmaatregelen bestaan er al? Belangrijke stappen zijn:

- Het inventariseren van alle AI-toepassingen en classificeren volgens de risicocategorieën.

- Het implementeren van een Information Security Management System (ISMS) om processen rondom AI en informatiebeveiliging te borgen.

- Het aansluiten bij bestaande normenkaders, zoals ISO 27001 en ISO 42001, die overlappen met de eisen van de AI Act.

- Het trainen van medewerkers in verantwoord gebruik van AI en het vastleggen van duidelijke rollen en verantwoordelijkheden.

- Vroegtijdig beginnen met de implementatie, zodat de overgang naar volledige compliance beheersbaar blijft.

Hoe voldoe je als organisatie aan de ISO 42001?

Wanneer je wil voldoen aan de ISO 42001-norm is het belangrijk om een AI-managementsysteem (AIMS) in te richten dat aansluit bij de eisen van de norm. Dit houdt in dat je:

- Processen in kaart brengt.

- Risico’s en kansen rondom AI identificeert.

- Ethische principes waarborgt.

- Zorgt voor voldoende transparantie.

- Zorg voor monitoring.

Na de implementatie van bovenstaande punten volgt een interne audit en directiebeoordeling. Als dit is voltooid, kun je een externe audit aanvragen bij een certificeringsinstelling om aan te tonen dat je voldoet aan de norm.

Start vandaag jouw voorbereiding. Base27 is er klaar voor

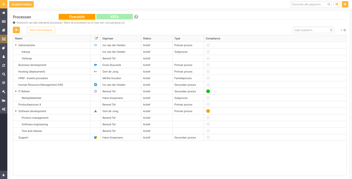

Nu je weet waarom je vroegtijdig moet beginnen met de voorbereiding om te voldoen aan de Europese AI Act is het belangrijk om de juiste tools hiervoor te gebruiken. Een ISMS zoals Base27 biedt je een solide basis. De tool staat gereed met de juiste normenkaders zoals de ISO 42001 en ISO 27001. Veranderingen worden direct verwerkt en zijn direct toepasbaar. Zo hoef je nooit meer haastige updates uit te voeren wanneer er nieuwe regels van kracht zijn gegaan. Jij bent altijd up-to-date en voorbereid op de toekomst.

Benieuwd hoe Base27 jouw organisatie kan ondersteunen om te voldoen aan de Europese AI Act?

English

English

Nederlands

Nederlands

.jpg)